Si estás interesado en descargar modelos de inteligencia artificial como DeepSeek desde Hugging Face, es probable que necesites un token de acceso. Este token es una clave de autenticación que te permite acceder a modelos privados o gated (restringidos). En este artículo, te explicamos paso a paso cómo obtener tu token y utilizarlo para descargar modelos como DeepSeek. Sin embargo, debes disponer de un SSD de 1 Terabyte exclusivamente para almacenar el modelo, ya que este pesa alrrededor de unos 700 GB.

¿Qué es un Token de Hugging Face?

Un token es una clave única que te identifica como usuario de Hugging Face. Algunos modelos, especialmente los privados o de acceso restringido, requieren este token para poder descargarlos. Es una medida de seguridad para controlar quién puede acceder a ciertos recursos.

Paso 1: Crear una Cuenta en Hugging Face

Si aún no tienes una cuenta en Hugging Face, sigue estos pasos:

- Visita el sitio web de Hugging Face.

- Haz clic en Sign Up (Registrarse) en la esquina superior derecha.

- Completa el formulario con tu correo electrónico, nombre de usuario y contraseña.

- Confirma tu cuenta a través del correo electrónico que recibirás.

Paso 2: Obtener tu Token de Acceso

Una vez que tengas una cuenta, sigue estos pasos para obtener tu token:

- Inicia sesión en tu cuenta de Hugging Face.

- Haz clic en tu perfil (esquina superior derecha) y selecciona Settings (Configuración).

- En el menú lateral, selecciona Access Tokens (Tokens de Acceso).

- Haz clic en New Token (Nuevo Token).

- Asigna un nombre a tu token (por ejemplo, “DeepSeek-Download”).

- Selecciona el rol del token. Para descargar modelos, el rol Read (Lectura) es suficiente.

- Haz clic en Generate Token (Generar Token).

Paso 3: Copiar y Guardar tu Token

Una vez generado, el token aparecerá en pantalla. Cópialo y guárdalo en un lugar seguro, ya que no podrás verlo nuevamente después de cerrar la ventana. Si lo pierdes, tendrás que generar uno nuevo.

Paso 4: Usar el Token para Descargar Modelos

Ahora que tienes tu token, puedes usarlo para descargar modelos como DeepSeek. Aquí te dejo el un script de Python para descargar, ejecutando este script podrá usar su token y automatizar el proceso de descarga. Recuerde siempre antes de ejecutar algún archivo, escanearlo en alguna plataforma antivirus como VirusTotal.

Consejos de Seguridad

- No compartas tu token: Trata tu token como una contraseña. No lo compartas públicamente ni lo incluyas en código que puedas subir a repositorios públicos.

- Usa variables de entorno: Para mayor seguridad, guarda tu token en una variable de entorno y accede a ella desde tu código. Por ejemplo: token = os.getenv(“HUGGINGFACE_TOKEN”)

- Revoca tokens comprometidos: Si crees que tu token ha sido comprometido, ve a la sección Access Tokens en Hugging Face y revócalo.

Cómo Ejecutar el Archivo de Python

A continuación, te explico cómo ejecutar este script de Python y una breve explicación de lo que hace cada parte del código.

Paso 1: Preparar el Entorno

- Instalar Python: Asegúrate de tener Python instalado en tu sistema. Puedes descargarlo desde python.org.

- Instalar dependencias: El script utiliza la biblioteca

huggingface_hub. Instálala ejecutando el siguiente comando en tu terminal o consola: pip install huggingface_hub

Paso 2: Guardar el Script

- Copia el código que te explico más adelante y guárdalo en un archivo con extensión

.py, por ejemplo,descargar_modelo.py.

Paso 3: Ejecutar el Script

- Abre una terminal o consola.

- Navega hasta la carpeta donde guardaste el archivo

descargar_modelo.py. - Ejecuta el script con el siguiente comando: python descargar_modelo.py

Paso 4: Seguir las Instrucciones

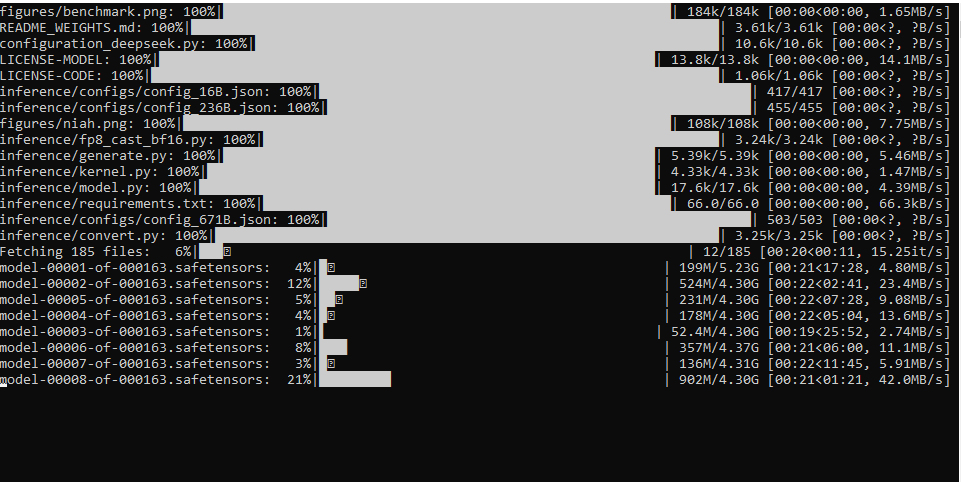

El script te guiará paso a paso:

- Te pedirá que elijas entre el DeepSeek V3 Base Model y el DeepSeek V3 Chat Model.

- Luego, te preguntará si deseas usar la ruta predeterminada (

C:/Models) o especificar una ruta manualmente. - Finalmente, descargará el modelo en la ruta que hayas elegido.

Explicación del Código

Aquí te explico brevemente qué hace cada parte del script:

1. Importar Bibliotecas

from huggingface_hub import snapshot_download import os

snapshot_download: Función de Hugging Face para descargar modelos.os: Biblioteca para interactuar con el sistema operativo (crear carpetas, manejar rutas, etc.).

2. Función elegir_ruta

def elegir_ruta():

print("\nAVISO: Introduce la ruta de guardado usando barras normales (/).")

print("- Ejemplo para Windows: C:/Users/TuUsuario/Documents/Models")

print("- Ejemplo para macOS: /Users/TuUsuario/Documents/Models")

print("Asegurate de que la ruta exista o tenga permisos de escritura.\n")

print("\n¿Donde deseas guardar el modelo?")

print("1. Usar ruta predeterminada (C:/Models)")

print("2. Especificar una ruta manualmente")

opcion_ruta = input("Introduce el numero correspondiente: ")

if opcion_ruta == "1":

return "C:/Models"

elif opcion_ruta == "2":

ruta_manual = input("Introduce la ruta completa donde deseas guardar el modelo: ")

ruta_manual = ruta_manual.replace("\\", "/")

return ruta_manual

else:

print("Opcion no valida. Usando ruta predeterminada (C:/Models).")

return "C:/Models"

- Esta función le pide al usuario que elija una ruta para guardar el modelo.

- Si elige la opción predeterminada, se usará

C:/Models. - Si elige una ruta manual, el usuario debe introducirla y el código reemplaza las barras invertidas (

\) por barras normales (/) para evitar errores.

3. Elección del Modelo

print("Selecciona el modelo que deseas descargar:")

print("1. DeepSeek V3 Base Model")

print("2. DeepSeek V3 Chat Model")

opcion = input("Introduce el numero correspondiente al modelo: ")

if opcion == "1":

modelo_nombre = "deepseek-ai/DeepSeek-V3-Base"

nombre_carpeta = "DeepSeek_V3_Base"

elif opcion == "2":

modelo_nombre = "deepseek-ai/DeepSeek-V3-Chat"

nombre_carpeta = "DeepSeek_V3_Chat"

else:

print("Opcion no valida. Saliendo del programa.")

exit()

- El usuario elige entre el Base Model y el Chat Model.

- Según la elección, se asigna el nombre del modelo y la carpeta donde se guardará.

4. Crear la Ruta de Guardado

ruta_base = elegir_ruta()

ruta_guardado = os.path.join(ruta_base, nombre_carpeta).replace("\\", "/")

os.makedirs(ruta_guardado, exist_ok=True)

- Combina la ruta base (elegida por el usuario) con el nombre de la carpeta del modelo.

- Crea la carpeta si no existe.

5. Descargar el Modelo

snapshot_download(

repo_id=modelo_nombre,

local_dir=ruta_guardado,

local_dir_use_symlinks=False,

token="TU-TOKEN"

)

- Descarga el modelo desde Hugging Face usando la función

snapshot_download. - El parámetro

local_dirindica la ruta donde se guardará el modelo. local_dir_use_symlinks=Falseevita el uso de enlaces simbólicos.tokenes tu clave de acceso para descargar modelos privados (si es necesario).

6. Mensaje Final

print(f"Modelo descargado en: {ruta_guardado}")

- Muestra la ruta donde se ha descargado el modelo.

Ejemplo de Ejecución

- Ejecutas el script: python descargar_modelo.py

- El script te pregunta: Selecciona el modelo que deseas descargar: 1. DeepSeek V3 Base Model 2. DeepSeek V3 Chat Model Introduce el numero correspondiente al modelo: (Eliges

1o2). - Luego: ¿Dónde deseas guardar el modelo? 1. Usar ruta predeterminada (C:/Models) 2. Especificar una ruta manualmente Introduce el numero correspondiente: (Eliges

1o2). - El modelo se descarga en la ruta especificada y el script muestra: Modelo descargado en: C:/Models/DeepSeek_V3_Base

Este script es una herramienta sencilla pero poderosa para descargar modelos de Hugging Face como DeepSeek. Con solo unos pasos, puedes elegir el modelo y la ruta de guardado, y el script se encarga del resto. Espero que te sea útil para tus proyectos.